OpenAI heeft onlangs zijn GPT-4o-model aangekondigd, een nieuw vlaggenschipmodel van de engine die ChatGPT aandrijft, de beroemde AI-aangedreven chatbot die voor het eerst werd uitgebracht in 2022. Dit nieuwere model tilt de interactie tussen mens en computer naar een geheel nieuw niveau door het sneller te laten lijken en veel natuurlijker.

In GPT-4o staat de ‘o’ voor ‘omni’, omdat tekst, beeld en audio in één model worden gecombineerd. Hoewel er geen verbetering is op het gebied van intelligentie en redenering ten opzichte van het GPT-4 Turbo-model, zijn er tal van nieuwe updates. Het is ontworpen om snellere, menselijker klinkende reacties te bieden en kan zelfs emoties simuleren. Het is ook aanzienlijk sneller in het begrijpen van visuele en audio-invoer. In deze diepgaande duik zullen we kijken naar de functies die GPT-4o biedt, en hoe dit een revolutie teweeg zal brengen in de manier waarop we omgaan met AI-assistenten. Dus doe mee en laten we aan de slag gaan!

GPT-4o is aanzienlijk sneller

Met het GPT-4o-model kan ChatGPT invoer in verschillende vormen accepteren, waaronder audio, tekst, afbeeldingen of combinaties daarvan. Het kan ook antwoorden in verschillende formaten bieden. Het meest indrukwekkende eraan is echter de snelheid waarmee u antwoorden krijgt.

Met het nieuwe model heeft ChatGPT slechts ongeveer 320 milliseconden of zelfs minder nodig om te reageren op audio-invoer, wat dichtbij de tijd ligt die iemand nodig heeft om te reageren in een gesprek. Daarnaast zijn de prestaties van GPT-4o vergelijkbaar met GPT-4 Turbo wat betreft het gebruik van Engels of het schrijven van code.

Het reageert ook veel beter op tekstgebaseerde invoer in niet-Engelse talen, en is aanzienlijk goedkoper in de API omdat het veel efficiënter is dan zijn voorganger.

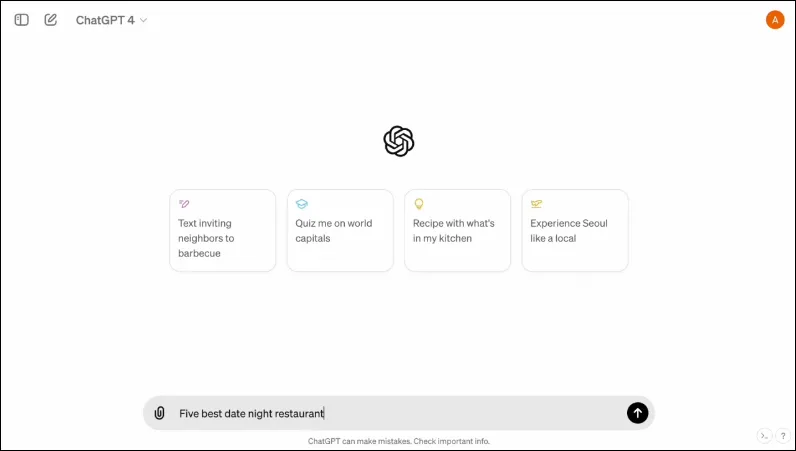

Het heeft ook een nieuwe interface, ontworpen om de interactie eenvoudiger en netter te maken.

Het is multimodaal

De bestaande Voice Mode van ChatGPT bestaat uit drie modellen. De eerste neemt op tekst gebaseerde invoer op en levert uitvoer in hetzelfde formaat, terwijl de tweede audio-invoer omzet naar tekst, die door ChatGPT wordt opgenomen om op tekst gebaseerde uitvoer te leveren. Het laatste model zet tekst om in audio.

Dit ontwerp resulteert echter in informatieverlies, omdat het model niet direct kan communiceren met de audio-invoer of de huidige uitvoer die emotionele elementen bevat. Met GPT-4o heeft OpenAI één multimodaal model gebouwd dat verschillende soorten input kan begrijpen en de vereiste output direct kan verwerken.

Het ondersteunt momenteel 50 talen en zal ook beschikbaar zijn als API.

Het kan menselijke emoties simuleren

Toen ChatGPT voor het eerst werd aangekondigd, was een van de grootste nadelen van de AI-chatbot voor veel mensen dat deze geen emotionele reacties kon bieden. Met GPT-4o kan ChatGPT menselijke emoties simuleren en geschikte reacties bieden die dergelijke emoties integreren.

In de demo’s die OpenAI deelt, is de chatbot te zien lachen, zingen en zelfs sarcasme tonen als hem daarom wordt gevraagd. Dit is een klasse hoger dan wat elke andere AI-chatbot momenteel kan doen en zal gebruikersinteracties veel leuker maken. Volgens OpenAI zal het nieuwe model ChatGPT ook in staat stellen de stemmingen van gebruikers te detecteren en op basis van die informatie adequate reacties te geven.

Gecombineerd met de mogelijkheid om visuele input te gebruiken, is de mogelijkheid om emotionele reacties te geven een van de meest indrukwekkende kenmerken die het nieuwe model biedt.

Het nieuwe model kan een grotere hoeveelheid informatie opslaan

Dankzij GPT-4o kan ChatGPT afbeeldingen, zoals grafieken en foto’s nu beter begrijpen en ook meer informatie over de gebruiker opslaan. Dit vertaalt zich ook in reacties die grotere stukken tekst kunnen bevatten, wat in verschillende gebruikssituaties handig kan zijn.

Je kunt de chatbot bijvoorbeeld vragen om nu grotere stukken tekst te vertalen en hij kan je helpen met live vertalen. Omdat het zowel visuele en audio-invoer als op tekst gebaseerde invoer kan gebruiken, kunt u het gebruiken om informatie te verzamelen uit schermafbeeldingen, foto’s en andere afbeeldingen.

Omdat het een grotere hoeveelheid informatie kan opslaan zonder dat gebruikers dit hoeven te herhalen, stelt GPT-4o gebruikers in staat deel te nemen aan heen-en-weergesprekken met de AI-chatbot. Met meer informatie kunnen gebruikers verwachten dat de gesprekken geavanceerder zullen zijn.

Waarborgen in het nieuwe model

Net als de bestaande GPT-modellen is de GPT-4o ontworpen met bepaalde waarborgen in gedachten om de veiligheid te garanderen. De trainingsgegevens zijn gefilterd en het gedrag van het model is na de training verfijnd. OpenAI heeft het AI-model ook geëvalueerd op basis van verschillende parameters, zoals cyberbeveiliging en overtuigingskracht, om ongewenste incidenten te voorkomen.

Daarnaast hebben de ontwikkelaars de hulp ingeroepen van meer dan 70 experts op verschillende gebieden, zoals desinformatie en sociale psychologie, om de risico’s die zich met het nieuwe model zouden kunnen voordoen of vergroten, te identificeren en te beperken. Ze zullen ook het gebruik van de chatbot blijven monitoren op toekomstige risico’s en de nodige acties ondernemen wanneer dat nodig is.

Om te beginnen zal OpenAI slechts een beperkte selectie van voorinstellingen voor stemmodellen beschikbaar stellen. Er wordt ook rekening gehouden met door gebruikers verstrekte feedback om het model te verbeteren en volledige veiligheid te garanderen.

GPT-4o-beschikbaarheid

Tot nu toe waren er twee versies van ChatGPT beschikbaar: een gratis versie die draaide op GPT 3.5 en een betaalde versie die draaide op GPT 4.0 en $ 20 per maand kostte. Deze laatste heeft toegang tot een groter taalmodel, waardoor hij grotere hoeveelheden gegevens kan verwerken.

GPT-4o zal beschikbaar zijn voor zowel gratis als betaalde gebruikers en zal naar verwachting in de komende weken naar apparaten worden uitgerold. Het zal beschikbaar zijn op mobiele apparaten via de bestaande app, die zal worden bijgewerkt, en naast de webversie voor desktopgebruikers zal er ook een nieuwe macOS-desktopapp beschikbaar zijn (de Windows-versie komt later dit jaar).

Om onderscheid te maken tussen gratis en betaalde gebruikers, zal OpenAI betaalde gebruikers vijf keer meer capaciteit bieden dan wat aan gratis gebruikers wordt aangeboden. Zodra uw limiet is bereikt, wordt u teruggeschakeld naar ChatGPT 3.5.

De aankondiging van OpenAI met betrekking tot GPT-40 komt slechts één dag vóór Google’s jaarlijkse I/O Developer Conference, waar Google naar verwachting zijn eigen AI-gerelateerde aankondigingen zal doen. OpenAI heeft ook beloofd dat er meer aankondigingen op komst zijn, dus er kan geen twijfel over bestaan dat de concurrentie tussen de twee rivalen net begint toe te nemen.

Hoewel we niet weten wanneer OpenAI meer wijzigingen in zijn AI-model zal onthullen, weten we wel dat GPT-4o op weg is naar apparaten die wereldwijd ChatGPT draaien. Houd dus uw vingers gekruist en wacht tot de update op uw apparaat verschijnt. Tot de volgende keer!

Geef een reactie