Op zijn jaarlijkse I/O-conferentie in Californië heeft Google verschillende aankondigingen gedaan met betrekking tot AI, waaronder nieuwe modellen en upgrades van bestaande modellen. Een van de meest interessante aankondigingen was Project Astra – een multimodale assistent die in realtime functioneert en de mogelijkheden van Google Lens en Gemini combineert om u te voorzien van informatie uit uw omgeving.

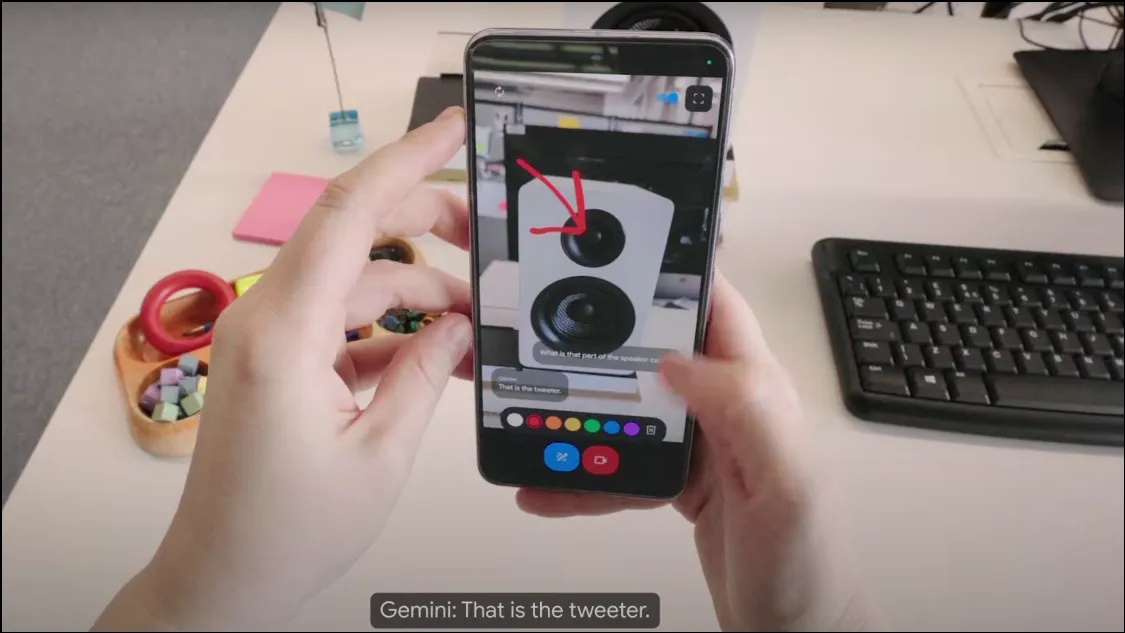

Hoe werkt Project Astra? Op de conferentie toonde Google een vroege versie van Project Astra, die functioneert als een cameragebaseerde chatbot en informatie uit uw omgeving kan verzamelen met behulp van de camera op uw apparaat. Omdat het een multimodale AI-assistent is, kan het audio, video en afbeeldingen als input gebruiken en op basis daarvan de nodige output leveren. Het draait op het Gemini 1.5 Pro-model, wat het ongelooflijk krachtig maakt.

De chatbot analyseert objecten en omgevingen in realtime en kan vragen zeer snel beantwoorden, waardoor hij veel lijkt op een menselijke assistent, of de geliefde JARVIS van Tony Stark. Project Astra werkt ook met wearables zoals slimme brillen, wat betekent dat er veel mogelijkheden zijn om de AI-chatbot in verschillende apparaten te integreren.

Project Astra kan de context waarin het wordt gebruikt beter begrijpen, informatie sneller verwerken en deze onthouden zodat deze sneller kan worden opgeroepen. De spraakmogelijkheden zijn ook veel verbeterd vergeleken met die van eerdere Gemini-modellen, waardoor het natuurlijker en menselijker klinkt.

Wat kan Project Astra doen? In de korte demo die Google liet zien, lijkt het erop dat Project Astra veel kan helpen bereiken. Het kan objecten en locaties observeren en begrijpen via de cameralens en microfoon en u er informatie over verstrekken. Je kunt bijvoorbeeld je telefoon gewoon op een stukje code richten en dit bespreken met de chatbot, of hem vragen een object en het gebruik ervan te identificeren.

Op dezelfde manier kan Project Astra, dankzij de mogelijkheden voor locatiebewustzijn, informatie over uw locatie verstrekken door simpelweg naar uw omgeving te kijken. Het kan ook de getoonde informatie vasthouden, wat best handig kan zijn als u zoekgeraakte items wilt lokaliseren, zoals gedemonstreerd in de demo toen het de gebruiker hielp zijn bril te vinden.

Ook kun je de AI-assistent om creatieve ideeën vragen, net als bij Gemini op je telefoon. Je kunt hem bijvoorbeeld vragen om de tekst van een nummer, een naam voor een muziekband of iets anders te bedenken. Kortom, Project Astra wil een universele AI-assistent zijn die u op een zeer gemoedelijke manier in realtime van informatie kan voorzien.

Wanneer zal Project Astra beschikbaar zijn? Tot nu toe heeft Google geen aankondigingen gedaan over de beschikbaarheid van Project Astra. De versie die in de demo wordt getoond is een vroeg prototype, maar Google liet doorschemeren dat deze mogelijkheden in een later stadium in de bestaande Gemini-app zouden kunnen worden geïntegreerd.

Met Project Astra streeft Google ernaar het voortouw te nemen in de evolutie van AI-assistenten, zodat ze nog nuttiger en gebruiksvriendelijker worden. Google is echter niet de enige die dit doel nastreeft. OpenAI heeft onlangs ook GPT-4o aangekondigd, waardoor ChatGPT multimodaal wordt, waardoor de mogelijkheden en efficiëntie worden vergroot. De nieuwe Voice Mode van ChatGPT (die binnenkort uitkomt) kan ook video-invoer van de camera van het apparaat gebruiken tijdens interactie met gebruikers.

Op dit moment is het verschil tussen de twee dat GPT-4o binnenkort beschikbaar zal zijn op alle apparaten waarop ChatGPT draait, terwijl Project Astra naar verwachting ergens in de toekomst beschikbaar zal zijn als Gemini Live, hoewel er momenteel geen releasedatum is. Nu GPT-4o-aangedreven ChatGPT eerder beschikbaar is, valt het nog te bezien of Google’s Project Astra goed genoeg zal zijn om te wedijveren met de populairdere chatbot van OpenAI.

Geef een reactie